في مدرسة الانتخابات.. الإعلام “المخ” و”التكنولوجيا” العضلات

انتهت معركة الانتخابات الرئاسية الأميركية الـ60 بفوز المرشح الجمهوري دونالد ترامب، ومع أنه من المبكر طرح السؤال الجدلي حول نزاهة الانتخابات وهل شاب العملية الانتخابية أي تدخلات سواء داخلية أو خارجية، فإن هذا السؤال سيبقى الهم الأكبر للمراقبين والصحفيين.

بالنسبة لنا كصحفيين ومهتمين بالتقنية فإن ما يهمنا هو أن لا يكون للمشاغبين “الإعلام والتكنولوجيا” دور مشبوه في هذه الانتخابات الأخيرة، لا سيما أنهما أثبتا خلال أكثر من مرة أنه في مدرسة الانتخابات لا يمكن أبدا التنبؤ بتصرفاتهما.

الإعلام “الدفة” والتكنولوجيا “البوصلة”

في عالم السياسة، لطالما كان الإعلام جزءًا حيويًا في تشكيل الرأي العام وتوجيه اهتمامات الناخبين ومن هنا وجدت نظرية ترتيب الأولويات (Agenda-Setting Theory) التي تفسر كيف يعمل الإعلام دور الموجه الذي يقود مشاعر الجماهير ويمكنه تغيير آرائهم، حيث تلعب وسائل الإعلام دورًا مهمًا في إبراز قضايا معينة وتجاهل أخرى، مما يجعل الجمهور يراها على أنها الأكثر أهمية.

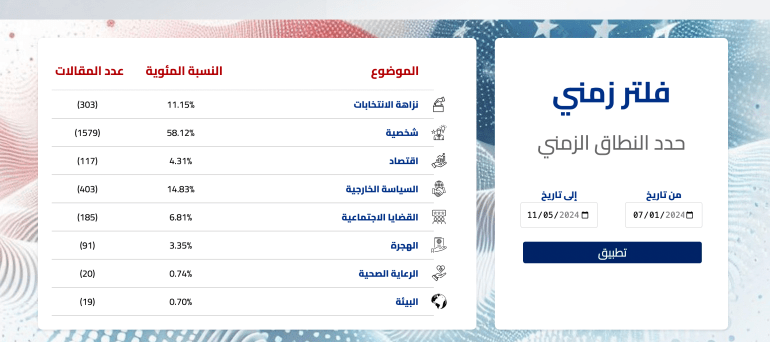

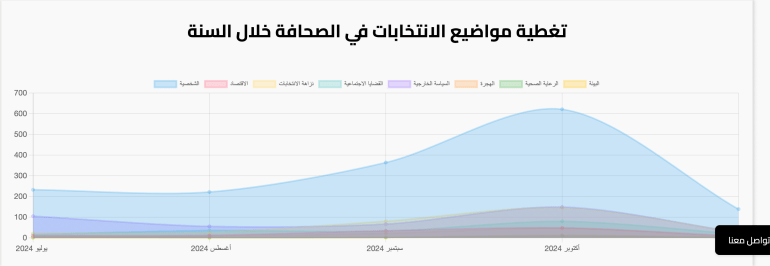

يظهر هذا جليا عندما نستخدم لوحة قياس مشاعر الإعلام التي طورها باحثون مستقلون بالتعاون مع صحفيين في الجزيرة ونحاول أن نرى على ماذا ركز الإعلام في الفترة الماضية.

سنلاحظ هنا بحسب لوحة قياس مشاعر الإعلام ومن خلال ملاحظة الخط الزمني من بداية العام أنه أصبح هناك صعود كبير في المقالات المنشورة والتي تركز على “شخصية” المرشحين بعد ترشح كامالا هاريس في يوليو/تموز حيث وصلت المقالات (1579) مقارنة بـ(326) بالفترة التي سبقتها، الممتدة من بداية يناير/كانون الثاني وحتى نهاية يونيو/حزيران من هذا العام.

هذا يظهر لنا كيف يلعب الإعلام دور السبوت لايت الذي يريد تسليط الضوء على موضوع معين أكثر من الآخر، ومن هنا نجد أن الإعلام هو الذي بيده دفة تغيير المسار بحكم أنه متغير ولكن ماهو دور التكنولوجيا؟.

مع صعود وسائل التواصل الاجتماعي في بداية الألفية، أصبح للأفراد والمنظمات إمكانية غير مسبوقة للوصول إلى الجماهير، وتوجيه النقاشات العامة بطريقة أكثر تأثيرًا مما كانت تفعله وسائل الإعلام التقليدية وحدها. هذا التطور غيّر قواعد اللعبة، وأعطى الحملات الانتخابية فرصة كبيرة للتفاعل المباشر مع الناخبين وقياس ردود الفعل بسرعة.

في السابق، اعتمدت الحملات السياسية على البيانات الديمغرافية وسجلات التصويت السابقة لتحديد شرائح الناخبين المستهدفة.

لكن اليوم، باتت تشهد الساحة السياسية تحولًا لافتًا مع تزايد اعتماد الحملات الانتخابية على الذكاء الاصطناعي في تحليل كميات ضخمة من البيانات واستهداف الناخبين وتخصيص الرسائل وتحسين الإستراتيجيات.

هذا التحليل يساعد على كشف أنماط تساعد في تحديد الفئات الرئيسية من الناخبين والتي قد تغيب عن المحللين التقليديين.

كما تسهم في تحديد الفئات الأكثر تأثرًا برسائل معينة، مما يمنح الحملات السياسية قدرة غير مسبوقة على توجيه مواردها بفعالية وتركيز جهودها على الشرائح الأكثر احتمالًا للتفاعل مع محتواها. بالإضافة إلى ذلك، يقوم الذكاء الاصطناعي بتحسين إستراتيجيات الحملات عبر التحليلات التنبؤية، مما يسمح بتوقع النتائج وتعديل الخطوات بشكل استباقي.

من هذه التحليلات ما يمكن أن نطلق عليه “التحليل العاطفي-السياقي” (Contextual Emotional Analysis). وهو مستوى أكثر تعقيدًا في التحليل النفسي بواسطة التكنولوجيا جاء مع دخول كامبريدج أناليتيكا في انتخابات 2016.

حيث استخدمت الشركة بيانات شخصية من ملايين مستخدمي فيسبوك لبناء ملفات نفسية مفصلة، مما أتاح لها إمكانية تخصيص إعلانات سياسية متوافقة مع شخصيات الناخبين ودوافعهم العميقة، هذا التحليل يأخذ بعين الاعتبار السياقات النفسية والاجتماعية، ويمكّن الحملات من بناء رسائل موجهة تتفاعل مع الخلفيات الفردية للناخبين.

ومع التطور المستمر في الذكاء الاصطناعي، يبدو أن هذه الأدوات لن تكتفي بتوسيع قدرات الحملات الانتخابية فحسب، بل قد تتيح أيضًا تطبيقات جديدة لهذه النظرية.

الذكاء الاصطناعي، بفضل تقنيات التعلم الآلي والشبكات العصبية، أصبح قادرًا على فهم العواطف الإنسانية بطرق أكثر تعقيدًا، ما يجعل الحملات الانتخابية قادرة على متابعة ميول الجمهور بدقة، وتقديم رسائل تتجاوز المفاهيم التقليدية.

من هنا نستنتج أن الإعلام هو الدفة التي توجه الرأي العام بينما التكنولوجيا ليست سوى البوصلة التي تحدد الاتجاه.

كيف يمكن لأستاذ “المنطق والأخلاق” أن يسيطر على الإعلام والتكنولوجيا؟

تواجه الحملات الانتخابية العديد من التحديات الأخلاقية عند استخدام الذكاء الاصطناعي لاستهداف الناخبين عاطفيًا، حيث يتمثل أحد أكبر هذه التحديات في استغلال نقاط الضعف العاطفية.

فمن خلال تحليل مشاعر الناخبين، قد تلجأ بعض الحملات إلى تركيز رسائلها على إثارة مشاعر الخوف أو القلق أو الغضب، مما قد يؤدي إلى تأثيرات غير متوازنة.

بالإضافة إلى ذلك، يمثل انتهاك الخصوصية تحديًا كبيرًا، إذ قد تُستخدم بيانات شخصية لم يدرك الناخبون أنها تخضع للتحليل، مما يثير قضايا حول حقوق الأفراد في حماية معلوماتهم. تخيل عالمًا تُحلل فيه سلوكياتك عبر الإنترنت لإنشاء ملف نفسي مفصل لك.

تقوم خوارزميات الذكاء الاصطناعي بمعالجة كميات هائلة من البيانات، لتحديد الأنماط والتفضيلات لبناء ملفات تُحدث باستمرار مع تدفق معلومات جديدة.

لكن ماذا يعني ذلك لتجربتك الانتخابية؟ المحتوى المستهدف بدقة الذي ينتج عن هذه الملفات مصمم لاستهداف المخاوف والطموحات والتحيزات.

تخيل نظام ذكاء اصطناعي يحدد الناخبين القلقين بشأن الهجرة، قد يقوم بعد ذلك بتقديم رسائل مخصصة تعزز سياسات مرشح ما بشأن الهجرة أو تشكك في موقف منافس له.

والنتيجة؟ تغييرات دقيقة في الإدراك والسلوك يمكن أن تؤثر على الناخبين غير المؤكدين أو حتى تثنيهم عن المشاركة في الانتخابات تمامًا.

وهناك أيضًا خطر التلاعب بالحقائق، حيث يمكن أن تتلاعب الحملات بالمعلومات وتوظفها لتغيير تصورات الناخبين بشكل مضلل، وهو ما يمس بمبدأ الشفافية في العملية الديمقراطية.

تتميز المعلومات المضللة التي تنتجها تقنيات الذكاء الاصطناعي بالقدرة على الانتشار بسرعة كبيرة. هذا التوسع السريع يعزز من التأثير المحتمل لحملات المعلومات المضللة، مما يجعل من الصعب على الأفراد والجهات المعنية التصدي لها.

باستخدام تحليلات البيانات وتعلم الآلة، يمكن للذكاء الاصطناعي تخصيص حملات المعلومات المضللة لتناسب فئات سكانية معينة.

بتتبع سلوك وسائل التواصل الاجتماعي والانتماءات السياسية، يمكن لهذه الأنظمة تحديد الأهداف الأكثر عرضة للتأثر بالمعلومات المضللة، مما يدفعنا للتساؤل: متى يصبح استخدام هذه التكنولوجيا تلاعبًا عاطفيًا يعيد تشكيل وعي الجمهور بطرق غير أخلاقية؟.

من الأمثلة البارزة على تجاوز الحدود الأخلاقية، كانت حملة دونالد ترامب عام 2016 التي استفادت من خدمات كامبريدج أناليتيكا. حيث استغلت هذه الشركة بيانات شخصية لملايين المستخدمين من فيسبوك لبناء ملفات نفسية، مما أتاح للحملة توجيه رسائل مصممة للتلاعب بمشاعر الناخبين واستهداف نقاط ضعفهم.

هذا السلوك أدى إلى ردود فعل غاضبة وانتقادات واسعة، وأدى إلى فضيحة كبيرة هزت قطاع التكنولوجيا والسياسة على حد سواء.

هذه الفضيحة أسفرت عن تغييرات في سياسات فيسبوك وإعادة تقييم شاملة لقوانين الخصوصية، كما دفعت المشرعين إلى التفكير في سياسات تحد من استغلال البيانات الشخصية في الحملات الانتخابية.

مع تعمق الذكاء الاصطناعي في المشهد السياسي، كشكل من الحرب النفسية يعيد تعريف كيفية التأثير على الناخبين. وهذا التلاعب سيؤدي إلى تآكل الثقة في المؤسسات الديمقراطية.

عندما يصبح الجمهور “مابيجمعش”

كشف استطلاع للرأي أجراه مركز “أب- نورك” لأبحاث الشؤون العامة أن حوالي 70% من الأميركيين يشعرون بالقلق أو الإحباط إزاء سير الحملة الانتخابية لعام 2024.

تعكس هذه النسبة مدى التشاؤم الذي يسيطر على الناخبين، حيث أبدى نحو الثلث فقط من المستطلعة آراؤهم أي حماس حقيقي تجاه الانتخابات، مما يُظهر تراجع مشاعر الإثارة التي عادة ما تميز هذا الحدث الوطني الكبير، وفقا لما نقلته وكالة “أسوشيتد برس”.

هذه المقدمة نشرت قبل أيام من يوم الانتخابات الحاسم حيث توضح بشكل كبير أن الجمهور لم يعد يرى بالعملية الانتخابية انعكاسا لآماله وأحلامه بقدر ماهي انعكاس لطموحات شخصية يضخمها الإعلام حول شخصية المرشحين وتساعده التكنولوجيا لمحاولة التأثير عليه.